AI时代来了?尝试下本地部署大模型进行代码编写。

前置说明

在Windows电脑上部署Ollama并运行模型,在同局域网的Mac上运行OpenCode使用。Windows的配置如下:

安装及配置

Ollama 下载:https://ollama.com/download

Ollama 官方主页:https://ollama.com

Ollama 官方 GitHub 源代码仓库:https://github.com/ollama/ollama/

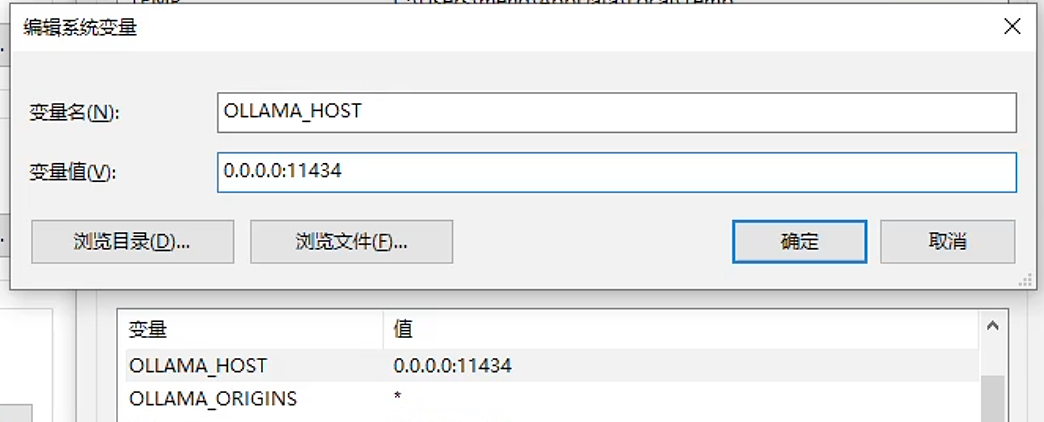

安装很简单,下载了打开Install就好了。安装完成后需要配置Ollama的监听网络地址,否则只能本地访问。

在环境变量中配置:

变量名(N):

OLLAMA_HOST

值:0.0.0.0:11434

以下是 Ollama 的环境变量配置说明:

| 参数 | 标识与配置 |

|---|---|

| OLLAMA_MODELS | 表示模型文件的存放目录,默认目录为当前用户目录即 C:\Users%username%.ollama\modelsWindows 系统 建议不要放在C盘,可放在其他盘(如 E:\ollama\models) |

| OLLAMA_HOST | 表示ollama 服务监听的网络地址,默认为127.0.0.1 如果想要允许其他电脑访问 Ollama(如局域网中的其他电脑),建议设置成 0.0.0.0 |

| OLLAMA_PORT | 表示ollama 服务监听的默认端口,默认为11434 如果端口有冲突,可以修改设置成其他端口(如8080等) |

| OLLAMA_ORIGINS | 表示HTTP 客户端的请求来源,使用半角逗号分隔列表 如果本地使用不受限制,可以设置成星号 * |

| OLLAMA_KEEP_ALIVE | 表示大模型加载到内存中后的存活时间,默认为5m即 5 分钟 (如纯数字300 代表 300 秒,0 代表处理请求响应后立即卸载模型,任何负数则表示一直存活) 建议设置成 24h ,即模型在内存中保持 24 小时,提高访问速度 |

| OLLAMA_NUM_PARALLEL | 表示请求处理的并发数量,默认为1 (即单并发串行处理请求) 建议按照实际需求进行调整 |

| OLLAMA_MAX_QUEUE | 表示请求队列长度,默认值为512 建议按照实际需求进行调整,超过队列长度的请求会被抛弃 |

| OLLAMA_DEBUG | 表示输出 Debug 日志,应用研发阶段可以设置成1 (即输出详细日志信息,便于排查问题) |

| OLLAMA_MAX_LOADED_MODELS | 表示最多同时加载到内存中模型的数量,默认为1 (即只能有 1 个模型在内存中) |

值得注意的是,Ollama模型默认存储在C盘,建议配置

OLLAMA_MODELS来更改存储位置。当然,也可以通过桌面客户端的Settings中Model location直接修改。

配置完记得重启 Ollama 服务 或者 重新启动你的 命令提示符 (CMD) 或 PowerShell 窗口,才能让新的环境变量生效。

模型库及下载使用

模型库地址:https://ollama.com/library

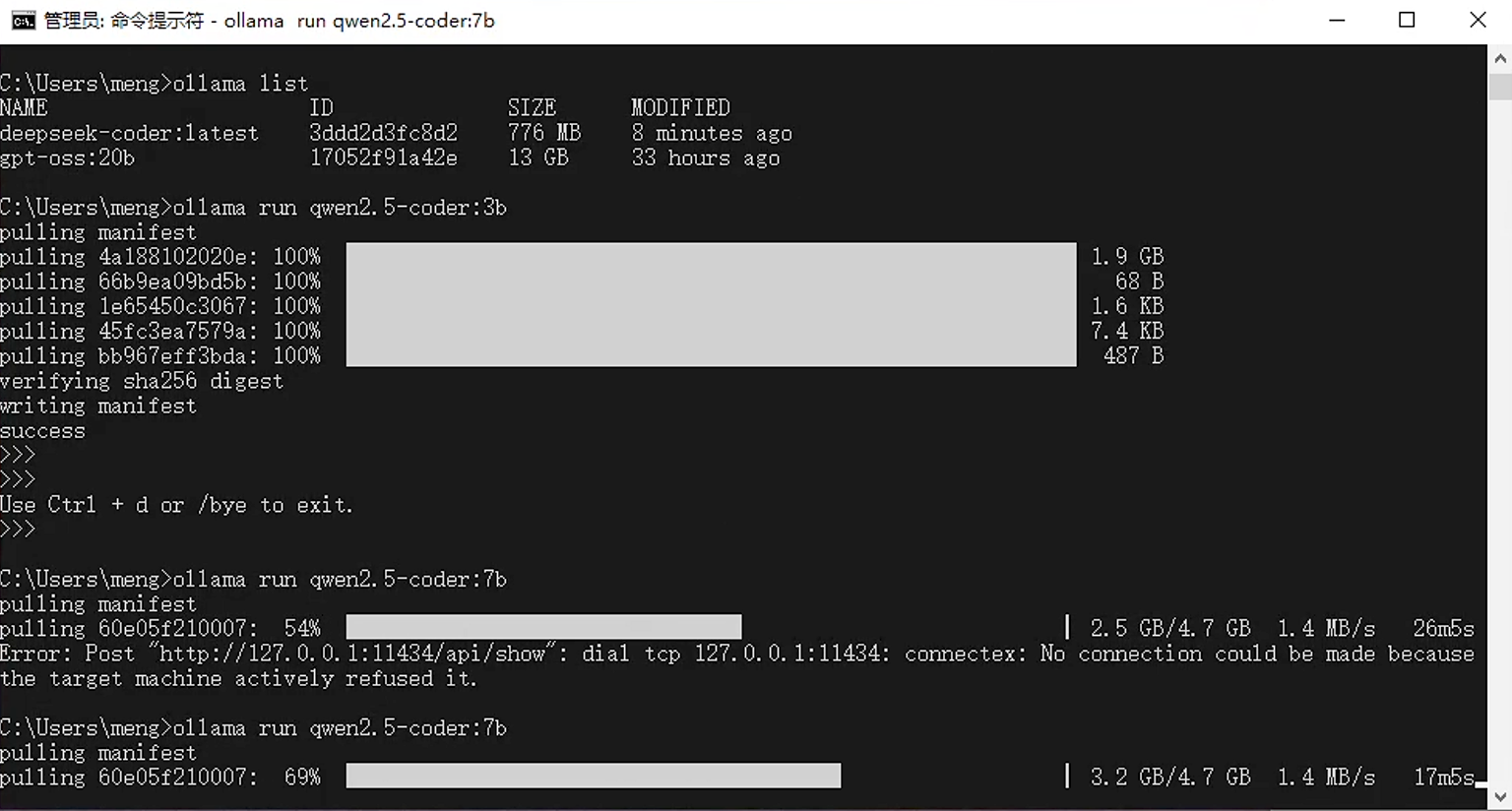

找到想要的模型直接启动,我这里选择了qwen2.5-coder ,因为跑模型的电脑配置摆在这里,所以这里测试qwen2.5-coder:3b和7b的模型。

启动命令:

1 | ollama run qwen2.5-coder:3b |

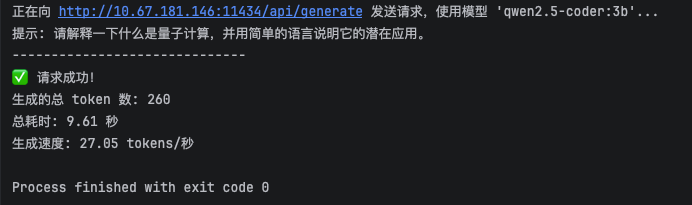

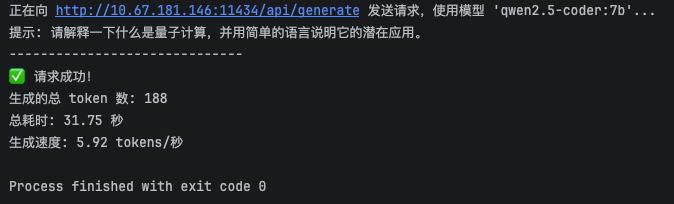

顺便我们也测试下Tokens

OpenCode安装及使用

回到Mac,先下载OpenCode,下载地址:https://opencode.ai/zh/download

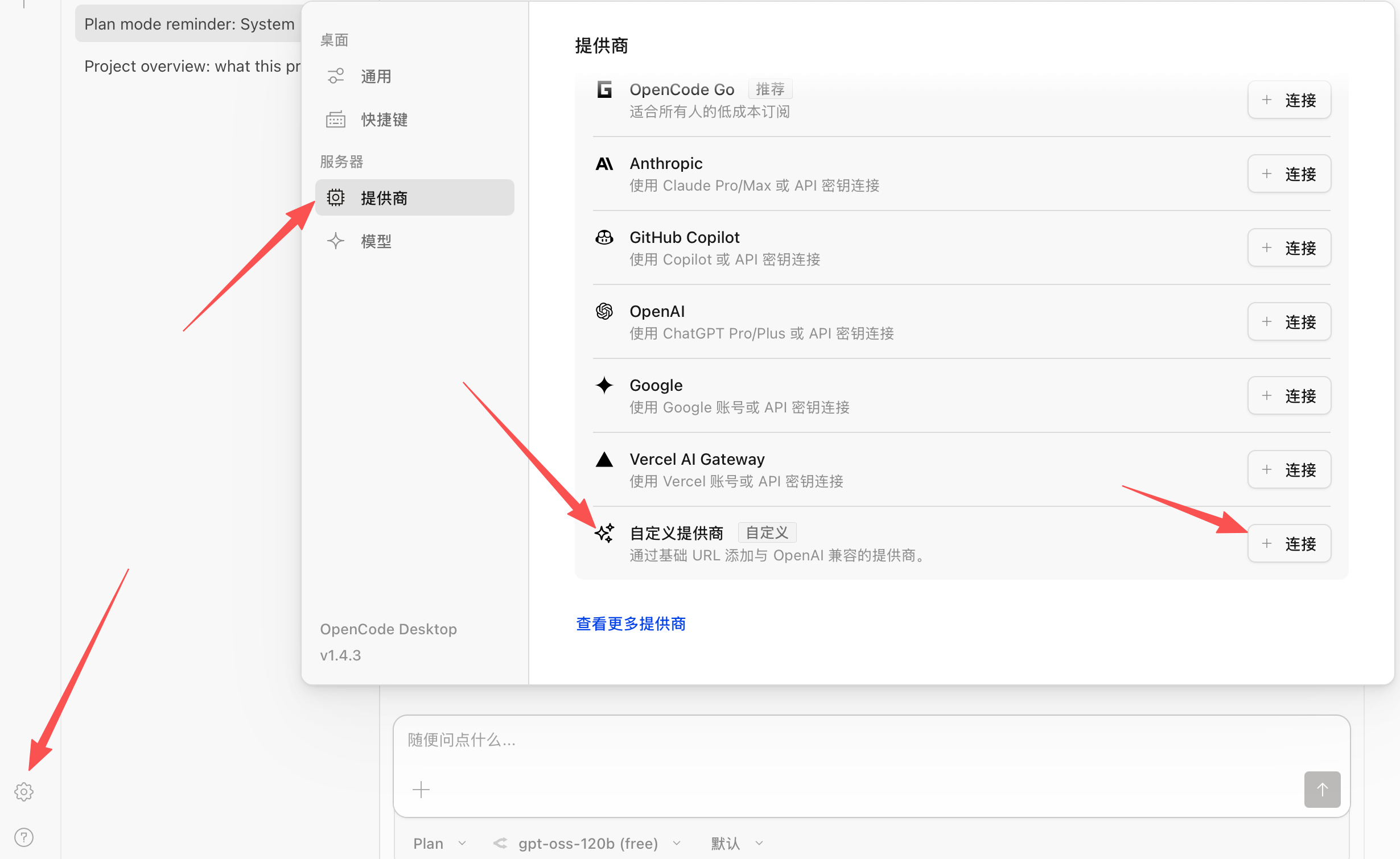

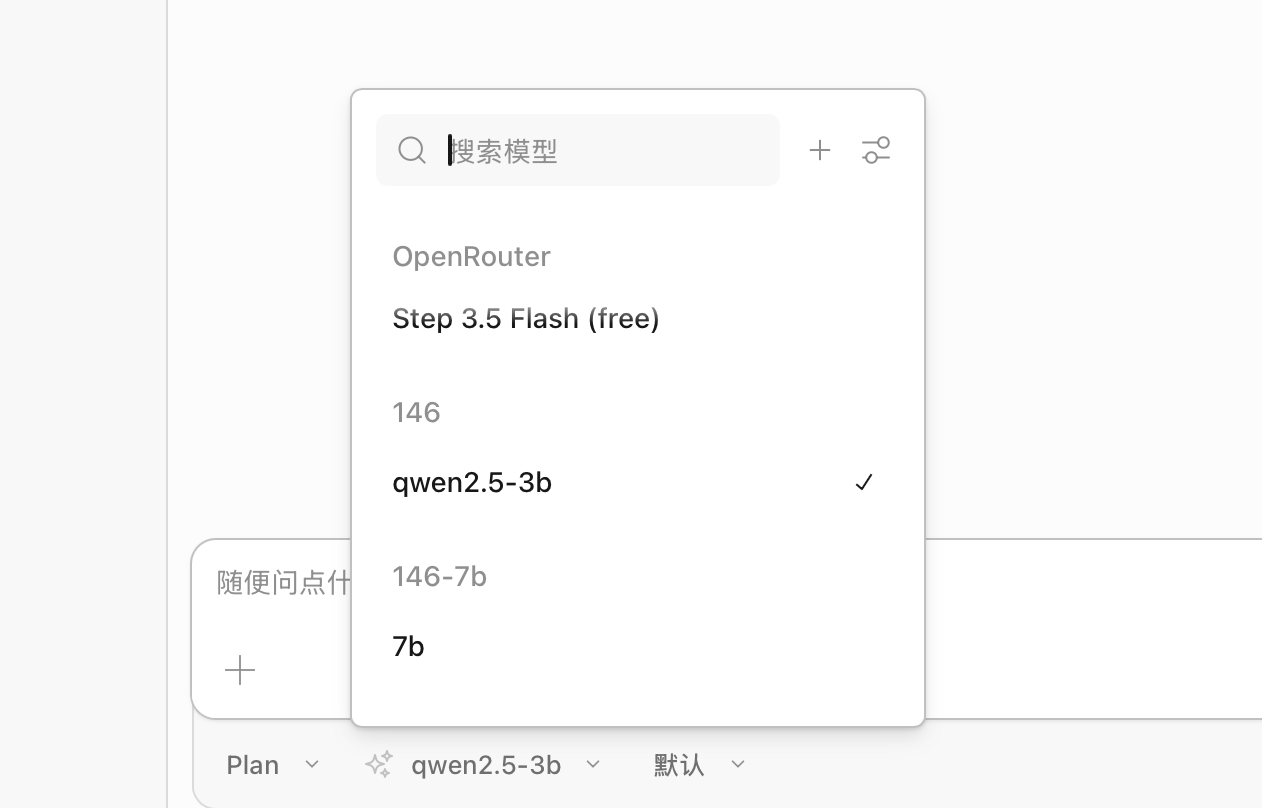

我这里下载的桌面版,点击左下角齿轮设置图标,进入设置窗口点击供应商,选择自定义提供商。

供应商ID:随意填写

显示名称:随意填写

基础URL:http://10.67.181.146:11434/v1

模型model-id:qwen2.5-coder:3b

模型显示名称:随意填写

基础URL中的IP和端口根据自身情况填写,模型model-id填写Ollama中使用的,可输入 ollama list 查看。

在OpenCode中选择自己的模型使用即可。

当然,这只是示例,这是代码生成模型,不是函数调用模型。

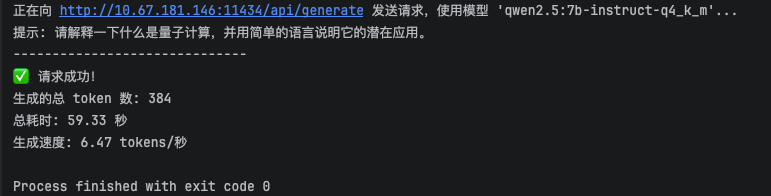

来玩一下适配的instruct版本试试: qwen2.5:7b-instruct-q4_k_m

入坑完成,准备烧钱。hhh~