之前使用了Ollama跑大模型,听起来LM Studio更加容易上手,这期来尝试下LM Studio。

前置说明

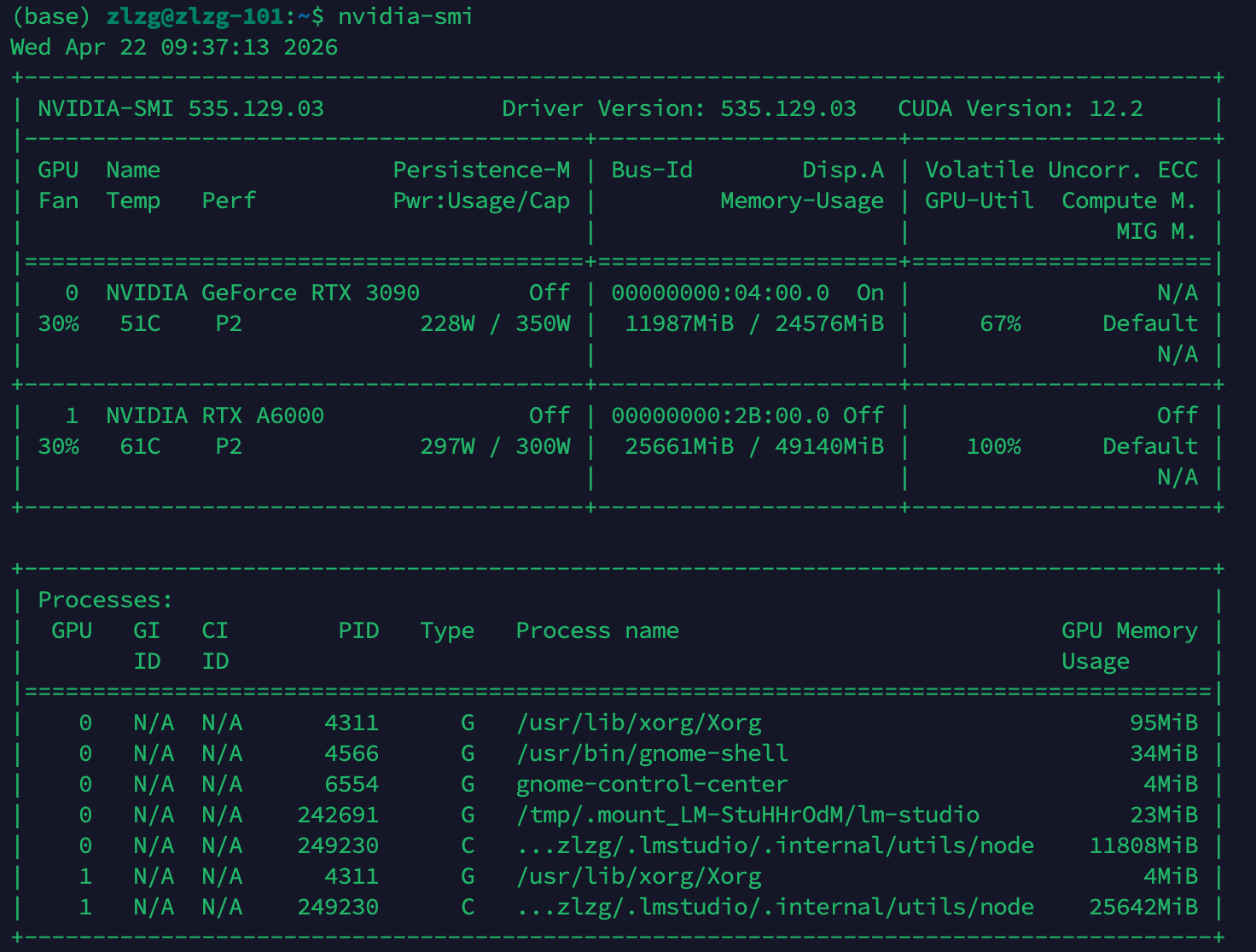

依然是先看配置,本次运行机器为ubuntu系统。

| 硬件 | 型号/规格 | 关键参数 |

|---|---|---|

| CPU (处理器) | AMD Ryzen 9 5900X | 12核心 / 24线程,最高加速频率 4.95GHz |

| GPU (显卡) | 双显卡配置 | 1. NVIDIA GeForce RTX 3090 (24GB 显存) 2. NVIDIA RTX A6000 (48GB 显存) |

| RAM (内存) | 128 GB | 无 |

安装及配置

LM Studio 下载:https://lmstudio.ai/download

LM Studio 官方主页:https://lmstudio.ai

也有无头模式:

Mac / Linux

curl -fsSL https://lmstudio.ai/install.sh | bashWindows

irm https://lmstudio.ai/install.ps1 | iex

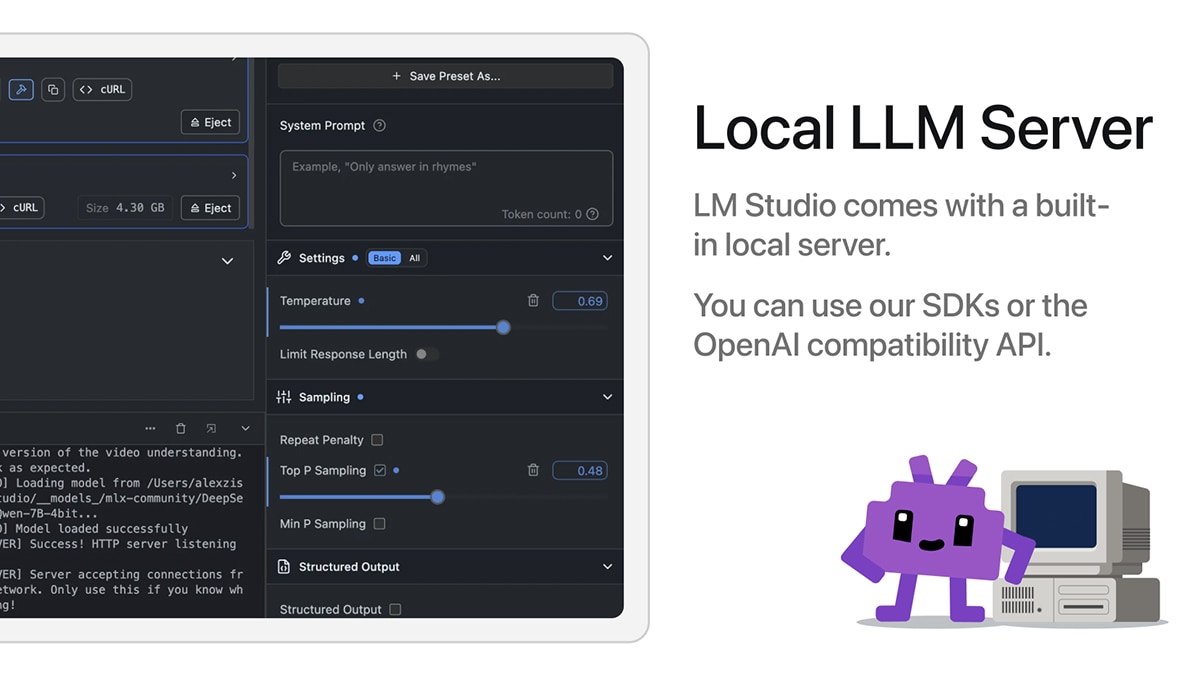

也提供了SDK:

JS SDK

npm install @lmstudio/sdk

Docs: lmstudio-jsPython SDK

pip install lmstudio

Docs: lmstudio-python

安装同样很简单,下载了打开Install就好了。

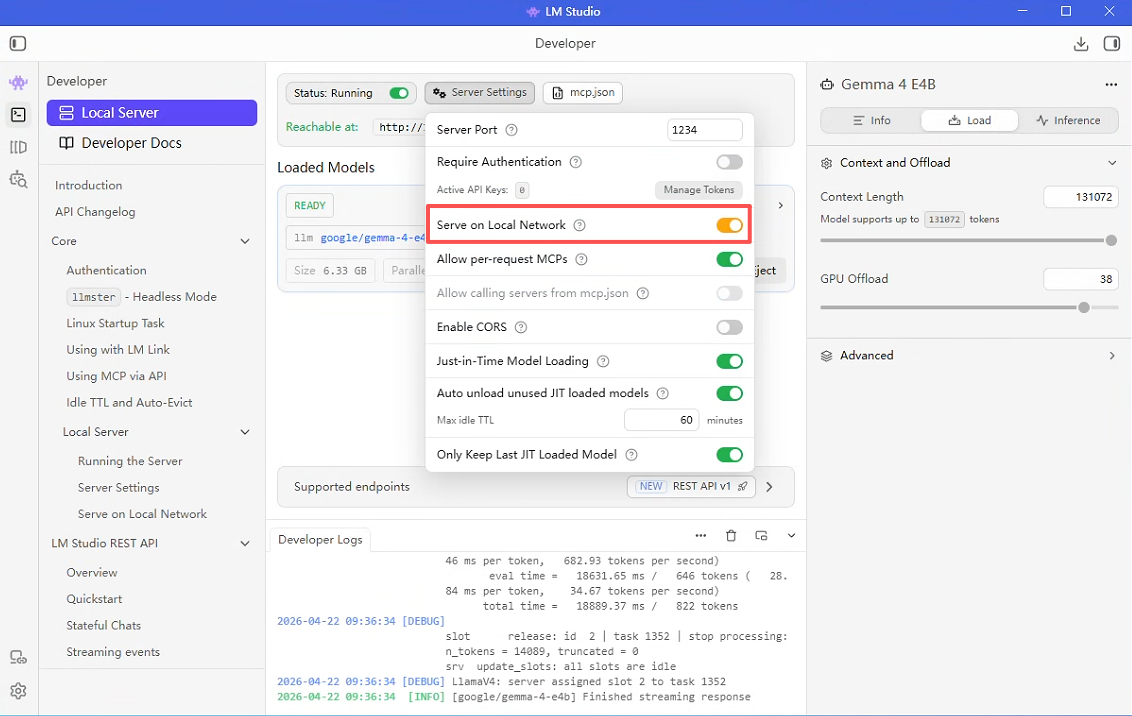

下载之后要把Serve on Local Network打开,否则只能本地访问。

因为ubuntu不方便截图,所以这里截图用windows系统安装的LM Studio,后续的使用由ubuntu上的LM Studio提供服务。

模型库及下载使用

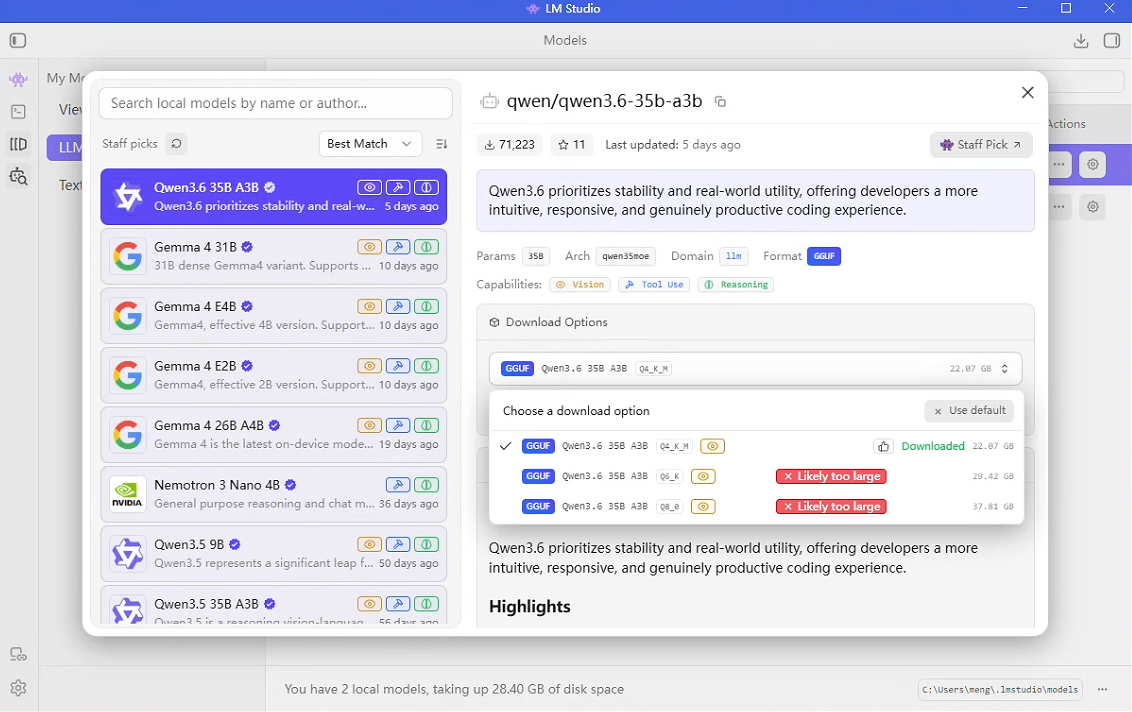

LM Studio会给你一些推荐,同时如果有超出机器配置的选择也会有对应的提示。

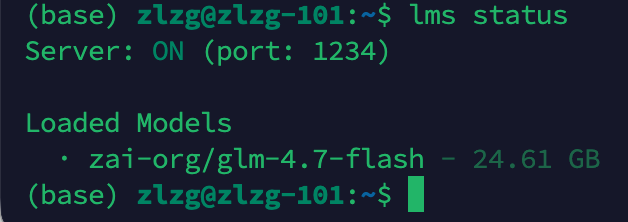

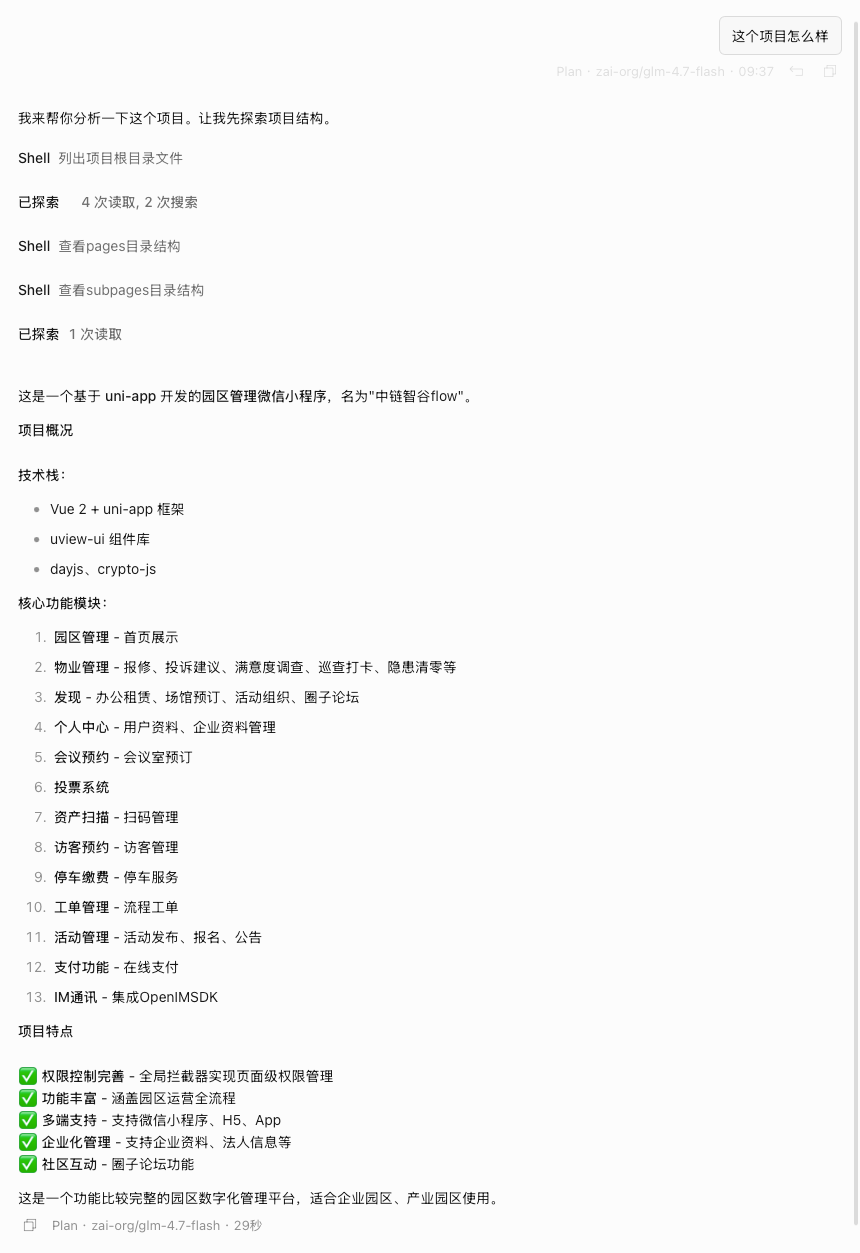

上面的显卡配置截图就是已经跑了zai-org/glm-4.7-flash - 24.61 GB后的,可以通过lms status命令查看。

接口依然openAi:http://127.0.0.1:1234/v1,依然用OpenCode来操作试试。

OpenCode安装及使用

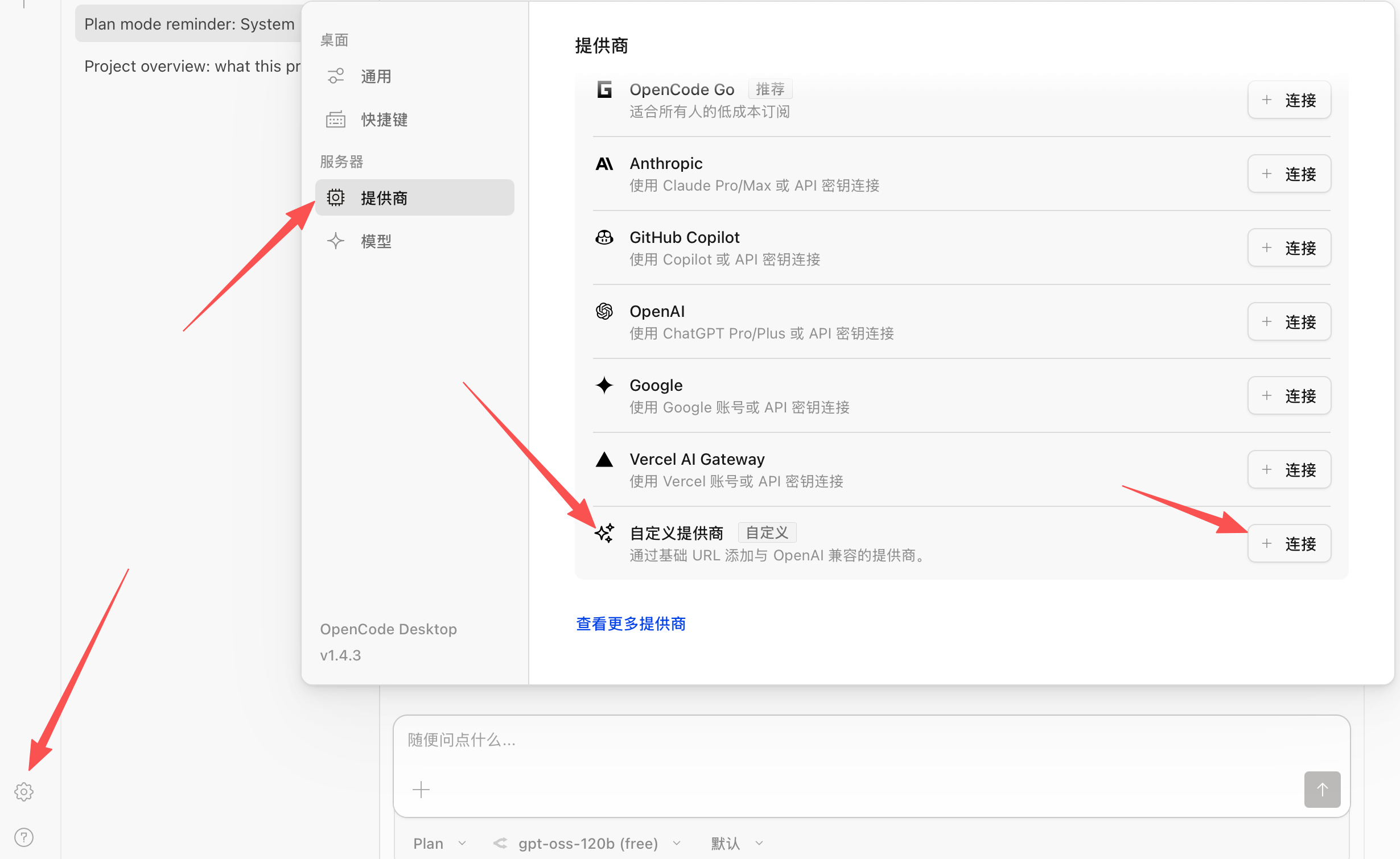

回到Mac,先下载OpenCode,下载地址:https://opencode.ai/zh/download

我这里下载的桌面版,点击左下角齿轮设置图标,进入设置窗口点击供应商,选择自定义提供商。

供应商ID:随意填写

显示名称:随意填写

基础URL:http://127.0.0.1:1234/v1

模型model-id:zai-org/glm-4.7-flash

模型显示名称:随意填写

基础URL中的IP和端口根据自身情况填写,模型model-id填写LM Studio中使用的,可输入 lms status 查看。

在OpenCode中选择自己的模型使用即可。

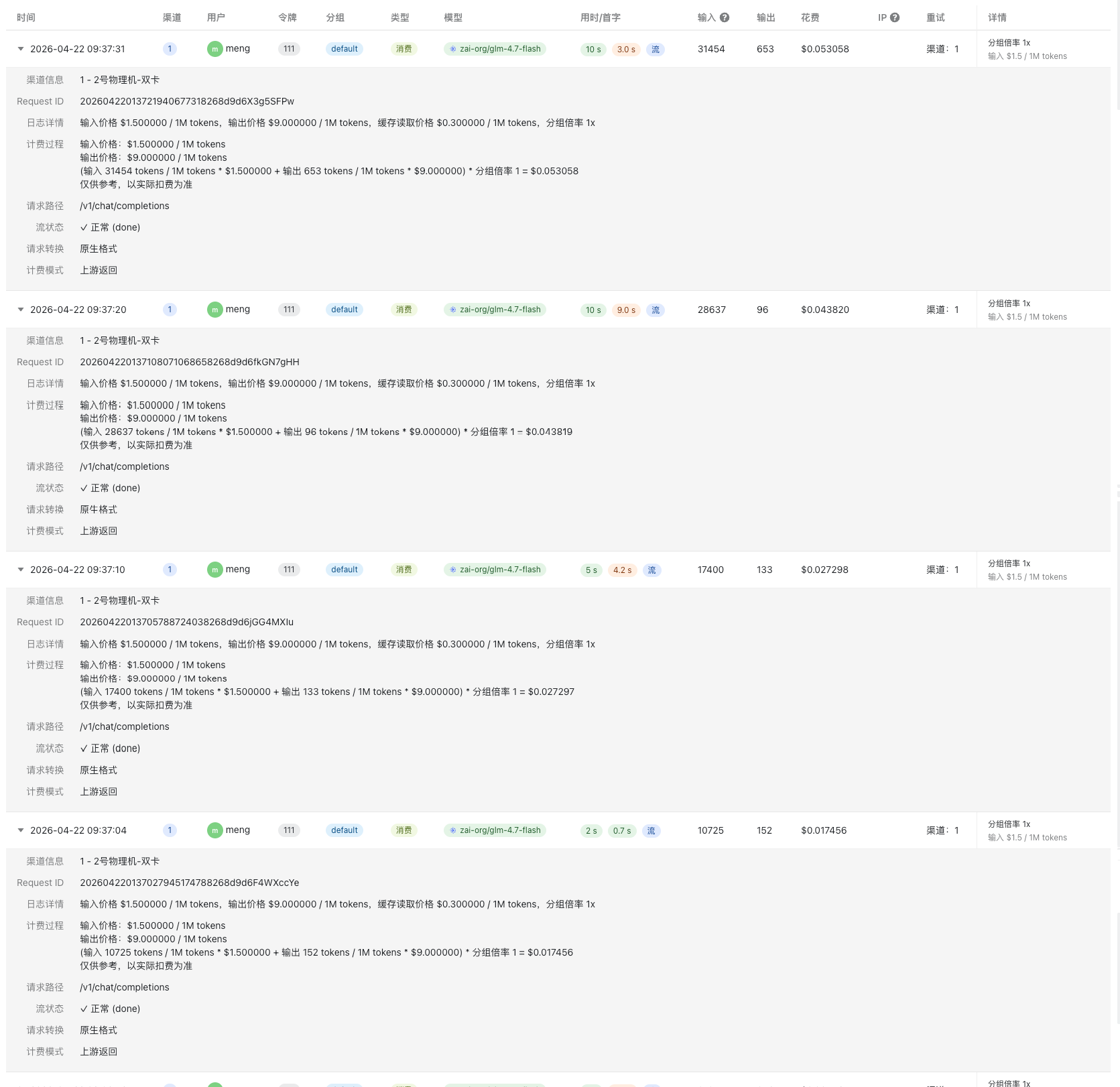

自己搭了一个数据集成平台,上面有看板,刚好可以贴一下。

可以看到速度等都是完全满足且有空余,这个模型只是示例,当模型聪明、token自由时,你想用来做什么?

演示引用

从官方博客看到几个内容,引用分享。